基于FCN-BiGRU的空中目标意图识别方法

作者: 丁鹏 宋亚飞

摘 要:随着科学技术的发展和作战方式的改变,对于敌方作战意图的推理开始进入战场,防空作战决策对于意图识别的准确率有更高的要求,现有的知识图谱、 专家网络和深度神经网络等方法在识别的精度上还存在差距,难以满足防空作战的需求。因此,本文结合卷积神经网络和循环神经网络的优点设计了一种用于空中目标意图识别的深度学习模型FCN-BiGRU,全卷积网络(FCN)可以提取空战数据中的复杂局部特征,双向门控循环单元(BiGRU)用来捕捉空战意图数据的时序特征,通过消融实验和对比实验证明,FCN-BiGRU模型的意图识别准确率达到98.71%,超过现有空中目标意图识别模型1.14%,为防空作战决策提供了更有力的依据。

关键词:深度学习; 空中目标; 意图识别; 全卷积网络; 双向门控循环单元

中图分类号:TJ760; TP183

文献标识码: A

文章编号:1673-5048(2023)05-0057-09

DOI: 10.12132/ISSN.1673-5048.2023.0002

0 引 言

世界经济水平的发展和科学技术的进步推动了现代战争体系的变革,作战方式趋向智能化,对敌方意图的推理在现代战争特别是现代空战中的作用日益凸显,越来越多的专家学者开展了大量意图识别相关研究。在防空作战中,对敌来袭空中作战力量意图的快速、 准确识别可以指导我方把握战场先机,有效捍卫领空安全[1-3]。

现有的意图识别方法主要包括专家系统[4]、 模板匹配[5-6]、 证据理论[7]、 贝叶斯网络[8-9]和神经网络[10-16]等。文献[4]通过专家经验构建知识库,使用推理机得到推理结果,通过对专家系统进行分析,其主要依靠知识库与完善的推理规则进行抽象处理,而战场环境复杂多变,仅凭借推理规则的力量很难实现全面覆盖; 文献[5-6]根据战场态势数据和专家经验构建态势模板,通过模板匹配的方式进行意图识别,这种方式没有考虑战场的复杂情况和战场数据的时序性,在识别的准确率方面存在较大的误差; 文献[7]针对海上舰艇对空中目标的意图识别特点,建立置信规则库,结合战场的态势特征, 通过推理进行意图识别; 文献[8-9]通过专家知识构建贝叶斯网络,通过概率论与图论结合的方式实现意图识别; 文献[10-16]通过构建神经网络,挖掘空战意图数据中的内部联系,模拟人脑进行意图识别,有效解决了传统意图识别方法的缺点,引入时序概念,将意图识别看作一个连续的过程,通过前后时刻的相互联系影响作战意图识别; 其中,文献[10-13]基于卷积神经网络(Convolutional Neural Networks, CNN)[14-15]和循环神经网络(Recurrent Neural Networks,RNN)[16-17]构建时序意图识别模型,取得了更高的准确率。

然而,现有的意图识别方法在识别的精度上还存在差距,难以满足防空作战的需求。在防空作战中,对于敌方意图的误判有可能造成我方的重大损失甚至整场战斗的失败,迫切需要新的意图识别方法提高识别准确率。空战意图特征数据中不仅存在时序特征,同样存在空间特征和局部特征,时序特征表达了作战过程中前后时刻采取行动之间的联系,空间特征主要表达位置、 速度等空间因素对于意图识别的影响,局部特征则体现了影响意图识别结果的关键局部因素。

针对上述问题,本文设计了一种基于FCN-BiGRU的空中目标意图识别方法,结合全卷积网络(Fully Convolutional Networks,FCN)[18-19]和双向门控循环单元(Bidirectional Gated Recurrent Unit,BiGRU)[20-21]提高识别准确率。CNN广泛应用于图像和时间序列中,CNN内的层可以从很少甚至没有预处理的情况下从数据中提取复杂的特征表示。FCN将CNN模型后面的全连接层替换为卷积层,可以较好地提取意图样本的空间特征,同时避免了CNN重复存储和计算卷积的问题,使模型更加高效。BiGRU有着比长短期记忆(Long Short-Term Memory,LSTM)[22-23]网络更小的块结构,并显示出与LSTM相当的性能,而且不需要额外的算法支持该模型,具有更少的训练参数、 更少的内存需求、 更少的训练时间、 更简单的硬件实现,具备较强的提取长距离依赖信息的能力。通过将FCN和BiGRU模型相结合,可以充分考虑空中目标意图样本的时间特征、 空间特征和局部特征,进一步提升意图识别的效果。通过消融实验和对比实验证明,FCN-BiGRU模型的意图识别准确率远远超过了现有的空中目标意图识别模型,取得更好的意图识别效果。

1 空中目标意图识别问题描述

空中目标意图识别主要包括以下过程:

(1) 根据作战类型、 战场环境等因素,确定空中目标作战意图空间;

(2) 采集战场时序数据,选取用于模型意图识别的空中目标意图特征空间;

(3) 进行数据预处理,形成空中目标意图数据集,划分训练集和测试集;

(4) 输入数据,进行模型训练和测试。

1.1 作战意图类型选取

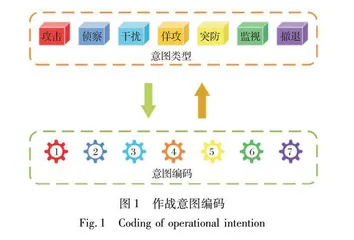

对于作战意图类型的选取,需要根据作战类型、 战场环境、 任务背景等因素综合考虑。如空中目标的意图类型就与海上目标的意图类型存在很大差异。文献[24]对于水下威胁目标建立的战术意图空间为{攻击、 规避、 巡逻}; 文献[10]根据敌方空中目标近岸空袭军事建筑为研究背景,建立的敌方空中目标的意图空间为{攻击、 突防、 侦察、 佯攻、 电子干扰、 监视、 撤退},本文重点研究防空作战中空中目标的意图识别问题,因此,针对防空作战的特点建立包含7种意图类型的作战空间,包括{攻击、 侦察、 干扰、 佯攻、 突防、 监视、 撤退}。

由于7种意图类型属于非数值型数据,为了将其转换为模型可以识别的数值型数据,分别对以上7种类型作编码处理,{1,2,3,4,5,6,7}分别对应意图空间{攻击、 侦察、 干扰、 佯攻、 突防、 监视、 撤退},如图1所示。如干扰意图对应的编码值为3,如果模型的输出结果为3,即模型判断空中目标作战意图为干扰。

1.2 作战意图特征选取

空中目标作战意图与其作战任务和战场环境情况密切相关。在考虑多方面因素的情况下,根据雷达、 传感器等测得的敌空中作战力量的时序数据判断敌机的作战意图。在执行空中任务时,敌机同一种意图类型往往表现出相同或相似的特征。如敌歼击机在空战攻击时通常采用较高的飞行速度,甚至可达1 400 km/h,敌机在执行高空突防任务时飞行高度往往会超过10 km[8]。同样,执行侦察任务时,通常会保持所有机载雷达处在开启状态,敌机在撤退时敌我距离逐渐增大且航向角朝向我方相反的方向。

综上所述,本文选取12种由数值型数据和非数值型数据构成的空中目标意图特征空间,表达敌机的作战意图,数据预处理后输入FCN-BiGRU模型进行意图识别。其中,数值型数据包括{敌我距离、 高度、 速度、 加速度、 航向角、 方位角、 雷达反射面积},非数值型数据包括{敌机类型、 对空雷达状态、 对地雷达状态、 机动类型、 干扰状态},如表1所示。

对于数值型数据,高度指敌空中目标的海拔高度; 敌我距离指敌空中目标与我军事中心的距离; 速度指敌空中目标的飞行速度; 加速度指敌空中目标的飞行加速度; 航向角为敌空中目标飞行方向(正北方向为0°,顺时针方向一周分为360°); 方位角为我方军事建筑到敌空中目标方向的方位角(正北方向为0×106 m,顺时针方向一周分为6.4×106 m); 雷达反射面积指敌战斗机的种类型号。数值型数据使用1个浮点型数据反映其大小,并对其进行Min-Max标准化。对于任意数值型数据x,标准化后的数据x′为

x′=x-min{X}max{X}-min{X}(1)

式中: X为数据x所属的特征种类的数据集合; max{X}为数据集合X中的最大值; min{X}为数据集合X中的最小值。

对于非数值型数据,敌机类型指敌战斗机的种类型号,对其进行编码; 对空雷达状态指敌机的对空雷达是否开启; 对地雷达状态指对地雷达是否开启; 干扰状态指敌机的干扰装置是否开启,以上数据编码为1或0,1表示开启,0表示关闭。机动类型指敌机主要采取的机动方式,以NASA学者根据空战中最常用的机动方式提出的“基本操纵动作库”[25]进行编码,包括{最大加速、 最大减速、 最大过载爬升、 最大过载俯冲、 最大过载右转、 最大过载左转、 稳定分型}7种机动动作。

2 意图识别模型描述

BiGRU可以在GRU捕捉样本一系列时序依赖的同时,利用未来信息进行判断和更新。FCN模型擅于提取时间序列数据的空间特征和细节变化规律,有效提高意图识别的准确率。为了充分利用其优点,将其组合成一个新的混合模型,以进一步提高意图识别精度,实验证明该模型在当前空中目标意图识别领域准确率、 召回率和损失值等评价指标上远远超越了其他现有模型。

2.1 全卷积网络

全卷积网络(FCN)是卷积神经网络(CNN)的一种变体,通过将CNN中的全连接层替换为不同参数的卷积层实现全卷积。CNN是一种具有深度结构的前馈神经网络,主要由卷积层、 池化层和全连接层组成,内部包含的卷积计算使其具有表征学习的能力,能够按照阶层结构对输入的信息进行分类,卷积核之间的参数共享和各层间的稀疏性连接,使其可以通过较小的计算量、 较稳定的效果提取数据的复杂局部特征,具备较高的学习效率,被学者广泛应用于图像处理问题和时间序列问题。空中目标的意图特征本质上是一种多维度时间序列,因此空中目标的意图识别问题本质上是一种时间序列问题。CNN的多层卷积结构能够自动学习到多个层次的空中目标意图特征,当卷积层较浅感知域较小时可以学习到目标意图的局部特征,当卷积层较深感知域较大时可以学习到对目标位置、 速度等敏感性更低的抽象特征,可以极大提高空中目标意图识别的性能。FCN通过替换掉原有的全连接层,避免了CNN存在的重复存储和计算卷积的问题,使模型更加高效地提取到空中目标意图时序数据中的复杂局部特征,为防空作战决策争取了更多的宝贵时间。

FCN模块由3个时序卷积(temporal convolutional)模块组成,每个时序卷积模块均包括1个一维卷积层、 1个batch normalization层(后接1个ReLU激活函数)和1个dropout层(丢弃率为0.3)组成。根据空中目标意图特征数量,设置第1个卷积层的输入通道数为12,输出通道数为128; 第2个卷积层的输入通道数为128,输出通道数为256; 第3个卷积层的输入通道数为256,输出通道数为128; 3个卷积层的卷积核大小分别设置为8,5,3。由此,切片后的航迹数据特征从12维映射到128维,并通过连接层将FCN层的输出与BiGRU层的输出拼接,实现同时兼顾空间和时间特征的FCN-BiGRU网络结构。

2.2 双向门控循环单元

循环神经网络(RNN)由于其内部循环单元的链式连接,使其在处理时间序列分类和预测等问题上应用广泛,在处理时间序列数据方面其有两个主要的变体,长短时记忆(LSTM)网络和门控循环单元(GRU),LSTM在内部由3个门(输入门、 遗忘门和输出门)组成,GRU则由2个门(重置门和更新门)组成,在性能上GRU相较于LSTM相差无几或者略有提升,但是GRU能够有效缓解深度RNN训练过程中可能出现的梯度消失和梯度爆炸的问题,同时采用了较LSTM更为简单的结构,很大程度上减少了工作量,提高了训练效率,更能满足防空作战对于时间紧迫性的要求。GRU的内部结构如图2所示。