用技术“对抗”技术从虚假信息到深度伪造

作者: 王治钧看电影的时候,我们突然发现银幕上的人脸被人动了“手脚”,原来是主角被“变脸”了。这是利用深度学习和人工智能技术合成高度逼真的虚假内容的“Deepfake”技术,它使人们更容易创作虚假内容。

在2023年的TED大会上,这项人工智能深度伪造技术更是震惊全场,因为它可以帮现场任何人实时实现深度造假影像和声音的目的。人工智能专家汤姆·格拉汉姆(Tom Graham)展示了包括实时换脸和语音克隆在内的若干功能,“人工智能生成的媒体内容看起来、听起来就像真实世界的产物,它即将席卷我们的生活”。

深度伪造:

更“深度”的犯罪

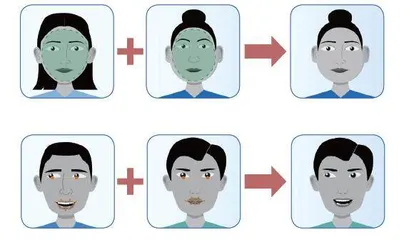

“Deepfake”指深度伪造技术,通常用于合成视频或图片,例如将电影中一个人的脸部特征替换成另一个人的脸部特征。这种技术可以用于制作虚假的视频、音频或图片,以及伪造某人的言论、行为或身份,因此受到广泛关注。

早在20世纪40年代,科学家就创建了这些可以“换脸”的计算模型的基础,但近些年人们才有了可以有效地使用它们的计算能力。研究人员将相关数据导入计算机模型,以学习文本的语言特征和语音声学特征之间的关系。只要少量新数据,就可以教会这些模型以不同人或不同风格说话,这为计算机合成灵活且适应性强的语音开辟了新的可能性。

近年来,相关技术的快速发展不仅大幅提升了高仿真内容伪造的效能,更降低了其内容制作的门槛。开发者利用开源软件能轻易修改图片、声音、文字等内容,民众也可轻易下载这类软件。

如何辨别深度伪造内容?

较为初级的检测方法依赖于模型,深度伪造生成内容的过程中图像会被引入伪影,人眼无法察觉,但可以被经过训练的模型检测出来。而更高级的检测方法可以识别画面中细微的不自然的部分,比如角色不会眨眼、口型对不上、肤色不协调、面部边缘闪烁、光源不一致,等等。深度伪造者更是难以将头发、珠宝、牙齿之类的细节渲染到尽善尽美。

人工智能已可以帮助人们进行识别,但现有的系统更适用于检测有关名人的深度伪造视频,因为系统可以免费在互联网上获得大量的名人影像资料,以此进行数小时的训练。有关科技公司正在研发更先进的检测系统,以达到“假货”出现时便将其标记的目的。

深度伪造:一柄双刃剑

深度伪造技术并不只有负面价值,人们可以利用它去创造一些更有趣、更有意义、更贴近人类情感互动的产物。它可以被人们用作制造与其去世的亲人相关的影音数据,重现相处和交流的场景,用现实、逼真的影像重建情感体验。

不仅如此,深度伪造技术也可以在医疗领域发挥重要作用,它有助于创建新的诊断和监控程序。医院可以利用Deepfake技术来构建Deepfake患者,用于测试和实验的患者数据真实而准确,但不会危及现实患者的安全,这为医疗领域探索新的程序打开了大门。

只依靠技术是无法解决深度伪造问题的,开发更先进的检测算法、制定相关法律法规、培养公众对相关信息的认知和辨别能力,研究人员、技术公司和政府机构正在共同应对它带来的威胁。面对网络上庞杂的图文信息,我们要更加警惕。

知识链接

对抗深度伪造,中国有“规”可依

生成式人工智能技术快速发展,为经济社会发展带来新机遇的同时,也产生了传播虚假信息、侵害个人信息权益、数据安全和偏见歧视等问题,如何统筹生成式人工智能的发展和安全引起各方关注。2023年7月,中国国家网信办等7部门公布了《生成式人工智能服务管理暂行办法》(以下简称《办法》),该《办法》自2023年8月15日起施行。

《办法》明确要求,生成式人工智能服务提供者应当依法开展预训练、优化训练等训练数据处理活动,采取有效措施提高训练数据质量,增强训练数据的真实性、准确性、客观性、多样性。应使用具有合法来源的数据和基础模型,按照《互联网信息服务深度合成管理规定》对图片、视频等生成内容进行标识,发现违法内容应当及时采取处置措施。涉及知识产权的,不得侵害他人依法享有的知识产权;涉及个人信息的,应当取得个人同意或者符合法律、行政法规规定的其他情形。