基于3D-CNN和ResNet的高光谱图像分类

作者: 王鑫

摘要:针对高光谱图像分类提出了基于3D-CNN和ResNet的3D-CNN-RES模型。高光谱图像经过PCA降维处理后,通过3D-CNN实现对高光谱图像的空谱特征提取,然后使用ResNet完成对图像的快速特征提取,在充分提取高光谱图像特征的同时,降低了网络的复杂度,提高了模型的地物表达能力。最后,高光谱图像分类任务通过Softmax分类损失函数来实现。通过实验验证,该算法模型相比SVM、2D-CNN和3D-CNN在Indian Pines数据集的分类结果中取得了较高的分类精度。

关键词: 高光谱图像分类;3D卷积神经网络;PCA; ResNet; Indian Pines

中图分类号:TP751 文献标识码:A文章编号:1009-3044(2023)16-0023-03

0 引言

高光谱图像(Hyperspectral Image, HSI) 可以提供丰富的光谱特征,通过高光谱图像能够观察到普通图像难以观测到的植被特征和土壤属性。高光谱图像的出现丰富了遥感领域,同时也推动了航天探测技术的发展[1]。高光谱图像的应用场景在作物识别、城市及城市周边地区特点、河流水质考核、矿产勘探等不同领域得到普及,高光谱遥感图像处理已经成为重要研究方向。

影响高光谱图像分类准确度的因素主要有两个。

首先,高光谱遥感图像往往包含数百种光谱,高维度光谱显著降低了分类的准确性。其次,高光谱遥感图像空间分辨率较高,其提供的丰富信息使得类内差异增多,从而导致较低的分类精度。传统的机器学习技术如K-近邻(K-NN) 、支持向量机(SVM) 、决策树等,通常与降维技术结合用于高光谱图像分类。这些方法都没有充分利用高光频谱图像的光谱信息,所以很难提高它们的分类精度。

为了提高高光谱图像的分类效果,深度学习技术成为首选。卷积神经网络(CNN) 等深度学习方法在高光谱图像分类中取得了良好的分类效果。We Hu等人[2]将1D-CNN用于高光谱图像分类中,实现了比传统SVM分类更好的分类效果,但1-D CNN只利用了光谱特征,难以充分利用空间特性。Li等人[3]在2DCNN的基础上提出了并行提取高光谱信息和频谱空间特征的高光谱分类模型。Ying Li等人[4]对高光频谱图像分类采用3D-CNN同步提取高光频谱图像空间和频谱特征,取得了较为理想的效果。然而高光谱图像包含的光谱和空间特征丰富,随着深度卷积网络复杂度的增加,使得深度卷积网络的训练计算量非常大,进而导致网络退化。

为了充分利用高光谱图像的空谱联合特征,并且避免由网络深度增加产生的网络退化和梯度消失问题,结合3D-CNN 和 ResNet提出了一种高光谱图像分类模型(3D-CNN-RES)。实验结果表明,该模型在Indian Pines数据集上的分类效果较为理想。

1 3D-CNN-RES 模型

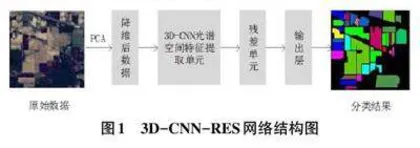

3D-CNN-RES网络结构如图1所示,主要由4部分组成,分别为PCA 降维、3D-CNN 图像特征提取、ResNet网络特征提取和Softmax分类。

1.1 PCA

主成分分析方法(PCA,Principal Component Analy⁃sis),作为一种数据降维算法在各领域都有应用。高光谱图像的波段范围广,其波段通常高达数百个,这使得高光谱图像容易产生“同物异谱”及“同谱异物”的现象。使用PCA降维高频谱图像,在保留最大特征量的同时,将原有的数百个频谱降为较低维度的数据,然后再进行3D-CNN特征提取。给定高光谱图像I ∈ ℝW × H × L,降维后的高光谱图像为X ∈ ℝW × H × D,其中W、H 为高光谱图像的宽和高;L、D 为经过PCA处理前后的波段数。得到降维后的高光谱图像X 后对其进行边缘填充,以像素pi,j 为中心提取尺寸为S × S × D的数据立方体Bij,1 ≤ i ≤ W,1 ≤ j ≤ H。

1.2 3D-CNN 网络

目前在图像领域,大多数使用的是2D-CNN,直接对二维图像进行卷积提取特征,然后由激活函数生成输出数据,对于光学图像而言,包含3维RGB数据,而高光谱图像通常由数百个波段组成。如果直接将二维卷积核用于高光谱图像,卷积核依次在各个通道上进行卷积,这可能导致大量的计算成本,进而产生过拟合。

在计算机视觉中,3D-CNN常用于时空特征的学习,如基于视频分析的应用,3D卷积能够充分提取三维特征,且参数维数较小。本文提出的方法将3D卷积应用于高光谱图像的立方体数据进行卷积,同时提取空间和光谱特征。计算3D 卷积的计算公式(1) 如下:

1.3 空谱特征提取网络

空谱特征提取网络由3个3D-CNN特征提取单元构成,每个3D-CNN特征提取单元结构由Conv3D层、归一化层、激活层和池化层组成,其网络结构如图2所示。

以输入第一层数据立方体Bij 的尺寸S × S × D =11 × 11 × 30为例,第1个3D-CNN特征提取单元的输入数据尺寸为11 × 11 × 30;第2个3D-CNN特征提取单元后数据尺寸为5 × 5 × 15;经过第3个特征提取单元后数据为2 × 2 × 7。其网络参数如表1所示。

1.4 残差网络

深度学习网络深度的增加会导致网络训练复杂,产生训练误差,He等人[5]提出了残差网络(ResNet) ,其主要特点是使用了“残差块”(residual block) ,其结构如图3所示。

残差块结构一般包含两层卷积网络和一个跳跃连接(shortcut connection) ,对于任意一个残差块,通过找到映射H (x)所对应的残差单元,从网络的输入到输出中,添加一个跳跃连接,此时目标变成寻找映射F (x),当F (x) = 0时,则H (x) = x,此时网络为恒等映射,故ResNet改变了训练方向,转变为学习残差映射: F (x) = H (x) - x。这种结构可以显著地解决深度学习网络中存在的梯度消失和梯度爆炸问题,从而可以构建更加深层的网络,获得更好的性能,同时采用残差块结构可以减少网络参数的数量,降低了网络的复杂度。

ResNet 在图像分类、图像识别等任务中都取得了很好的性能,成了深度学习领域中的重要技术之一。

近年来,许多学者已经将ResNet用于高光谱图像的分类,Dang等人[6]通过将残差连接与深度可分卷积相结合,构建了一个训练参数较少的残差单元,并将该模型用于Pines等数据集分类,该模型保证了更高的分类精度,同时在训练和测试样本点上花费的时间更少;Li等人[7]提出了一种双分支ResNet网络,这两个分支被用于分别提取光谱特征和块特征,取得了较好的分类效果。

3D-CNN-RES采用的残差网络构造如图4所示,残差单元包括两个3D-CNN卷积层,两个归一化层和一个激活层。其中3D-CNN 层中卷积核尺寸为3 ×3 × 3,核数量为64,步长为1,激活函数为ReLU。

1.5 输出网络

高光谱数据经过残差单元处理后,经输出网络处理完成高光谱图像的分类。输出网络层由三层构成,分别为池化层、全连接层和Softmax 层。3D-CNNRES使用Softmax损失函数对最后高光谱特征进行分类。在训练中,为了避免模型过拟合,采用随机梯度下降(SGD) 优化器优化目标函数,对参数进行学习,得到预测模型的最优参数。

2 实验结果与分析

2.1 数据集

为了验证提出的方法,实验验证选用Indian Pines 数据集进行分类精度测试。Indian Pines数据集通过AVIRIS传感器在美国印第安纳州进行拍摄和采集,图像在400至2500纳米波长范围内,实际有200个波段用于训练。拍摄区域包含了16种地物类型,包括玉米、燕麦、小麦、树木等。选择高光谱图像中的3个波段生成的彩色图像和Ground Truth图像如图5所示。

将本文提出的3D-CNN-RES 方法与SVM、2DCNN、3D-CNN进行对比,对比实验将以每类样本的10%作为训练数据训练模型。

2.2 参数设置

Indian Pines数据经过PCA降维,将数据从200个波段降维30个波段,数据立方体的大小为11 × 11 ×30,训练epoch为300,学习率为0.1。

2.3 实验结果与分析

不同模型在Indian Pines数据集的分类精度如表2所示。

从表2中可以看出,本文提出的3D-CNN-RES算法的OA优于其他算法,表现出了较高的分类优势。

与3D-CNN 相比,3D-CNN-RES 算法精度提高了2.41%。结果表明,3D-CNN-RES 模型通过引入ResNet进一步提高了分类效果。

3D-CNN-RES算法在Indian Pines数据集上的分类效果,如图6所示。

从图6中观察可知,3D-CNN-RES模型获得分类结果噪声更少,更加接近真值图像。

3 结束语

针对高光谱图像光谱维度高、空间信息利用不足和深度卷积网络难以训练等问题,结合3D-CNN 和ResNet 提出了一种新的高光谱图像分类模型3D3DCNN-RES。首先,使用主成分分析方法实现在对高光谱图像降维的同时保留图像特征,然后,利用3DCNN结合ResNet完成对图像特征进行提取;最后,用Softmax损失函数完成对高光谱图像的分类。通过对Indian Pines数据集实验验证表明,3D-CNN-RES模型表现出了较好的分类效果。

参考文献:

[1] rBeimouoctea s-seDnisaisn gJ Mda,Ptal aazan aAly,sCias mapnsd- Vfuatlulsr eG ,ceht aallle.Hngyepse[rJs]p. eIEctEraEl

[2] GHeuo sWci,eHnucea nagn dY R Ye,mWoteei SLe,nest ianlg. DMeaegpa zcionnev,2o0lu1t3io,1n(a2l ):n6e-u3r6al. net⁃ swoorrsk,2s 0f1o5r ,2h0yp1e5r:1sp-e1c2t.ral image classification[J].Journal of Sen⁃

[3] cLoin Xvo,Dluitniogn Mal nLe,Purižaul rniceatw Aor.kD feoerp h fyepaetursrpee fcutsraiol ni mvaiag et wcola-ssstirfeicaam⁃ t2i0on2[0J,]5.8IE(4E):E2 6T1r5a-n2sa6c2t9io.ns on Geoscience and Remote Sensing,

[4] hLyi pYer,sZpheacntrga lH i mKa,gSehreyn w Qit hA 3.DSp ceocntrvaoll–utisopnaatli anle culraasls nifeictwatoirokn[ Jo]f.

[5] HReem Ko tMe ,SZehnasnign gX,2 Y01,R7e,9n( 1S) :Q67,e.t al.Deep residual learning for im⁃ aagned rPeactotgenrnit iRone[cCo]g/n/2it0io1n6 (ICEVEPER C).oJnufneree n2c7e- 3o0n, 2C0o1m6p,uLtaesr VVeisgiaosn,

[6] NDVan,Ug SLA .XIE,PEaEn,g2 0P1 6D:7,7L0e-e 7J7.8D.epth-wise separable convolution angeeu rcalla snseiftiwcoartkio nw[iJt]h.R reemsiodtuea Sl ecnosninnge,c2t0io2n0 ,f1o2r (2h0y)p:3er4s0p8e.ctral im⁃

[7] wLiit hT aR d,Zuahla-nbgr aXn cHh ,RZehsaNnge t Sf oHr ,heytp aelr.sSpeelcft-rsaul piemravgisee dc lalesasirfnicinag⁃ t1i-on5[.J].IEEE Geoscience and Remote Sensing Letters,2022,19:

【通联编辑:唐一东】